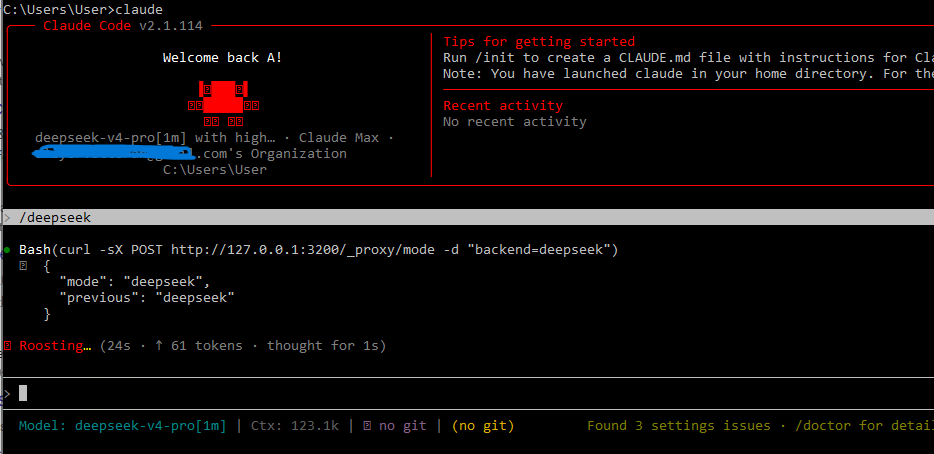

DeepSeek V4深度评测:性能追平Claude Opus 4,价格仅1/8

2026年4月24日,中国AI实验室DeepSeek终于发布了万众期待的V4系列首个预览版本——DeepSeek-V4-Pro和DeepSeek-V4-Flash。这两个模型不仅在性能上直逼前沿,更以令人难以置信的价格颠覆了市场格局。

模型规格与架构

两款模型均采用百万token上下文的混合专家(MoE)架构:

DeepSeek-V4-Pro:1.6万亿总参数,490亿活跃参数。这是目前全球最大的开源权重模型,超越了Kimi K2.6(1.1T)和GLM-5.1(754B),是DeepSeek V3.2(685B)的两倍多。模型文件865GB。

DeepSeek-V4-Flash:2840亿总参数,130亿活跃参数。模型文件仅160GB,轻量级量化后有望在128GB内存的个人设备上运行。

两个模型均采用MIT开源协议,完全开放权重。

性能评测

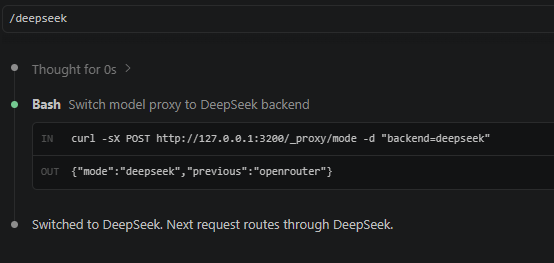

通过OpenRouter实测,V4系列在多项任务上展现出与GPT-5.4、Claude Opus 4等前沿模型相当的性能。以经典的「骑自行车的鹈鹕」SVG生成测试为例:

V4-Flash生成的鹈鹕已经相当不错,而V4-Pro更是呈现出令人惊艳的细节表现。相比去年12月的V3.2版本,进步幅度肉眼可见。

定价:颠覆性低价

DeepSeek V4最引人注目的不是性能,而是价格。以下是DeepSeek官方API定价:

DeepSeek-V4-Flash:输入 $0.14/百万token,输出 $0.28/百万token

DeepSeek-V4-Pro:输入 $1.74/百万token,输出 $3.48/百万token

与其他前沿模型的对比:

| 模型 | 输入 ($/M) | 输出 ($/M) |

|---|---|---|

| DeepSeek V4 Flash | $0.14 | $0.28 |

| GPT-5.4 Nano | $0.20 | $1.25 |

| Gemini 3.1 Flash-Lite | $0.25 | $1.00 |

| DeepSeek V4 Pro | $1.74 | $3.48 |

| Claude Opus 4 | $15.00 | $75.00 |

| GPT-5.4 | $15.00 | $60.00 |

| Gemini 3.1 Pro | $3.50 | $14.00 |

V4-Pro的价格不到Claude Opus 4的1/8,性能却几乎追平。而V4-Flash更是以$0.14的超低价,成为目前性价比最高的百万token级上下文模型。

技术亮点

DeepSeek V4系列在以下方面有显著突破:

超长上下文处理:百万token的原生上下文窗口,可以一次性处理整本小说的内容,或完整代码库的上下文理解。

MoE效率优化:Flash版本仅13B活跃参数,意味着推理成本极低,运行速度极快,但得益于1.6T的总知识储备,输出质量丝毫不打折扣。

中文能力登顶:作为中国团队开发的模型,DeepSeek V4在中文理解、生成、翻译等任务上达到了前所未有的水平。

完全开源:MIT协议意味着任何人都可以自由使用、修改、商用,没有任何限制。

为什么这很重要?

DeepSeek V4的发布标志着AI行业的一个转折点:高性能AI不再是少数巨头的专利。当你可以用不到Claude二十分之一的价格获得几乎相同的性能时,整个AI应用生态的游戏规则都变了。

对于开发者而言,这意味着可以用更低的成本构建更复杂的AI应用。对于企业而言,这意味着AI部署的ROI大幅提升。对于整个行业而言,这预示着AI民主化的真正到来。

DeepSeek V4不是终点。随着V4系列的持续迭代,我们有理由期待一个性能更强、价格更低、更加开放的AI未来。